放送を取り巻く最新動画配信技術【Connected Media TOKYO 2019レポート】

編集部

2019年6月12日〜14日の3日間、千葉県・幕張メッセにて、マルチスクリーン・クラウド・ビックデータなどデジタルメディア分野における技術を集めたカンファレンス『Connected Media TOKYO 2019』が開催され、全期間で15万人を超える来場者を記録した。今回はこの中から、6月14日に開催された専門セミナー「放送を取り巻く最新動画配信技術」をレポートする。講演者は、株式会社フジテレビジョン 技術局 技術開発部 副部長の伊藤正史氏。放送を取り巻く動画配信技術に関する同社の研究開発の模様を紹介した。

■地上波とネット配信の連携をマスターレベルで実現

新しい送出マスター

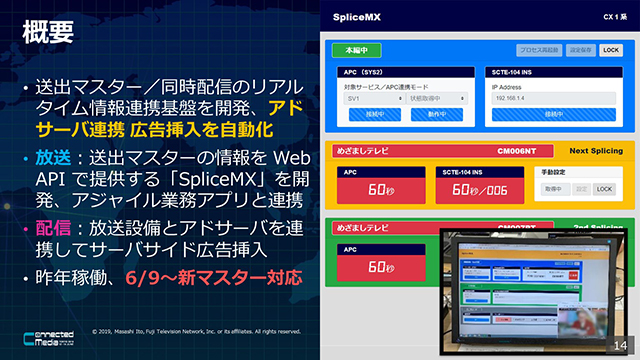

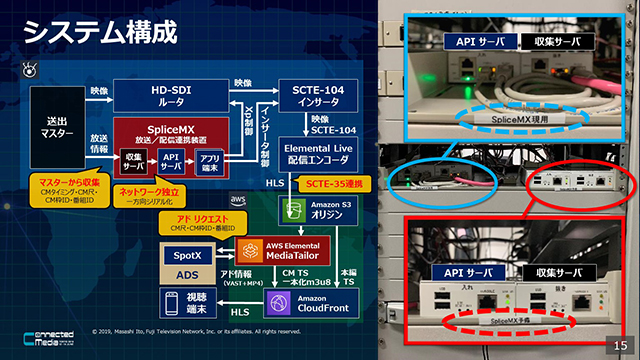

新しい送出マスターフジテレビでは2018年、放送送出マスターとインターネット同時配信をリアルタイムで連携する基盤を開発。Web API(WEB Application Programming Interface:ウェブ技術を用いてシステム同士を連携させる仕組み)を用いてマスターの運行情報をリアルタイムで取得できる独自機構「SpliceMX」を通じ、アジャイル(Agile:個々に独立して稼働し、システム同士の接続によって大規模・柔軟な機能を実現する)業務アプリとの連携を実現したほか、放送設備とアドサーバーを連携させ、「SSAI(Server Side Ad Insertion:サーバーサイド広告挿入=サーバー側でコンテンツに広告を自動挿入する手法)」にも対応した。

2019年6月、送出マスターの更新にともない、同システムとの本格連携を開始。マスターの仕様そのものに大きな改変を与えることなく、放送と通信の連携基盤を実現した。

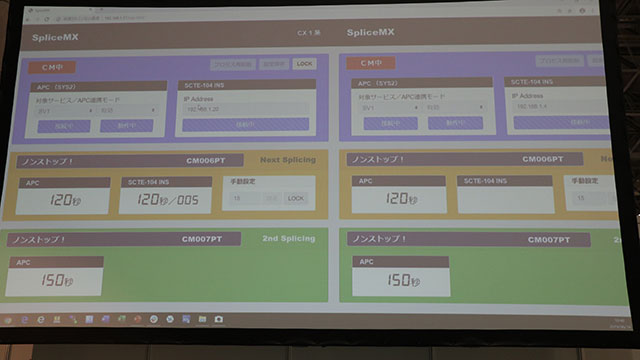

「SpliceMX」は、小型Linux端末を活用した「マスター情報収集サーバー」をマスターに接続し、リアルタイムな放送運行データを取得。一方向シリアル接続(IPネットワークを介さず、機器同士を直接結ぶ通信方法)でAPI(連携用情報)サーバーに情報を伝達する。各業務アプリはAPIサーバーに問い合わせを行なうことで、マスターと切り離された環境で安全に、制御に必要な放送運行データを取得することができる。

SpliceMX実機デモ

SpliceMX実機デモ同システムからは周辺機器を経由してSCTE-104(放送素材差し替えトリガー情報)の制御や、配信映像にフタをするビデオルーター、動画配信用エンコーダーの自動制御も可能。ネット配信される動画データに広告情報を直接挿入し、インターネット同時配信においても通常のテレビCMとほぼ変わらない感覚で動画広告の挿入が可能となった。

「カウキャッチャー(番組枠中、本編前に送出)」「ヒッチハイク(番組枠中、本編後に送出)」「ステーションブレイク(番組枠と番組枠の間に送出)」といった、異なる種類のCMチャンスの出し分けについてはSCTE-104に重畳する情報とアドサーバー側で対応。インターネット配信において、柔軟な広告配信を行える仕組みを整えているという。

■デバイス間差異・再生遅延への対策技術

インターネット配信において課題となってくるのが、多岐にわたる再生デバイスごとの仕様差、データの受信タイミングによる再生遅延に対するフォロー。これらに対する技術的な対策の方法も伊藤氏は解説した。

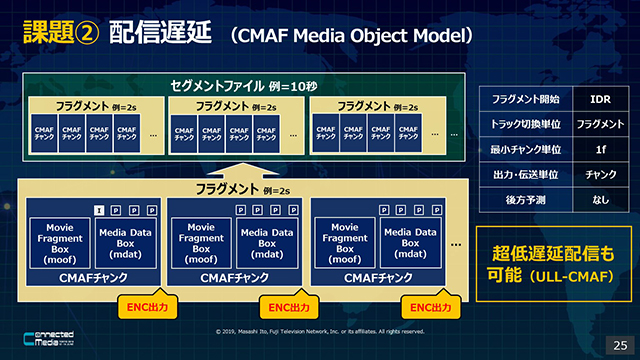

デバイスごとの差異を埋める方法として、伊藤氏らは「CMAF(Common Media Application Format)」と呼ばれる規格を用いた配信に取り組んでいると言う。CMAFは使用する配信方式に依存しない共通の動画フォーマット規格で、既存の主要な動画配信方式で使え、さらに現状よりも細かい動画データ単位での配信を行なうこともできる。

主な配信方式には「HLS」と「MPEG-DASH」があり、これまではそれぞれの方式で用いる動画フォーマットが異なっていた。さらに、受信環境によっては配信方式が固定されるため、一つの配信方式で運用する場合には、受信端末側では環境に応じて動画フォーマットの変換処理が必要になるなど、技術的な負担が大きかった。「CMAF」は共通の動画フォーマットとして複数の配信方式で利用できるため、受信側では環境に適した動画変換作業が不要となり、マルチデバイス対応が容易になるという。

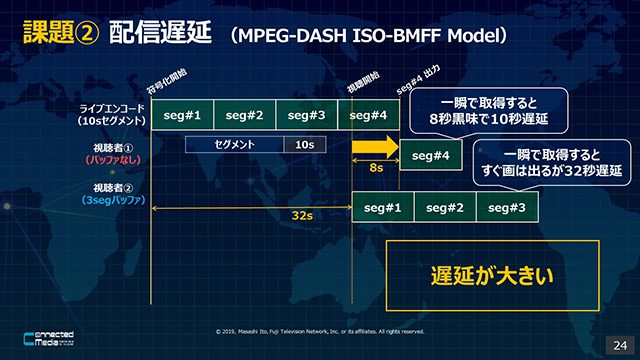

これまで起きていた再生遅延の課題に対しては、動画データの配信単位を細かくし、さらに「受信端末に届いたものから順に再生できる」エンコードとすることで対策できると伊藤氏は語る。これまでの動画データは「セグメント」と呼ばれる一定の長さのファイル単位で送る形であったため、視聴開始時に作成中のセグメントファイルが届くまで「再生待ち」が発生するか、すぐに再生を始められる代わりに少し前のセグメントファイルから再生することになり、これが再生遅延の原因となっていた。「CMAF」では、これまでのセグメントファイルよりも細かい(最短1フレーム単位の)「CMAFチャンク」と呼ばれる単位に動画データを分けて配信することで遅延を縮め、さらに後方のフレームを参照するような圧縮符号化も避けることで、超低遅延配信(ULL-CMAF: Ultra Low Latency-CMAF)を選択することも可能になるという。

■配信動画における「即時通知・時間指定イベント」への対応

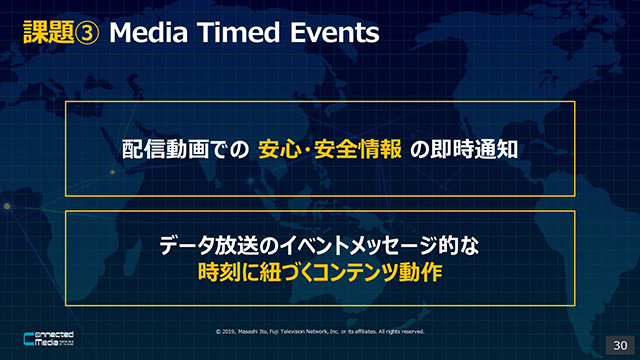

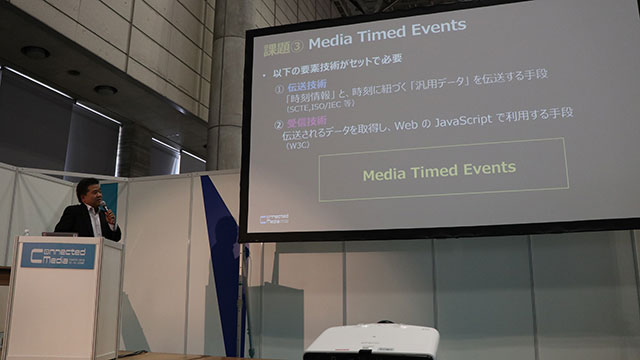

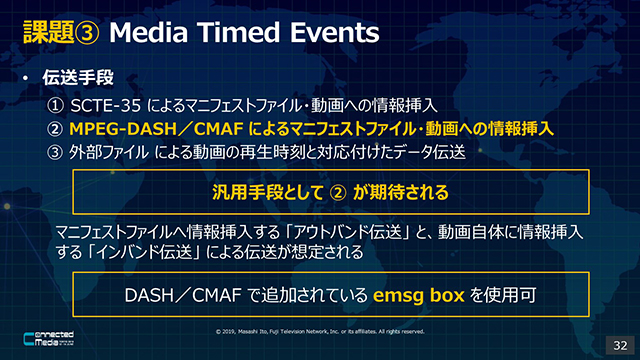

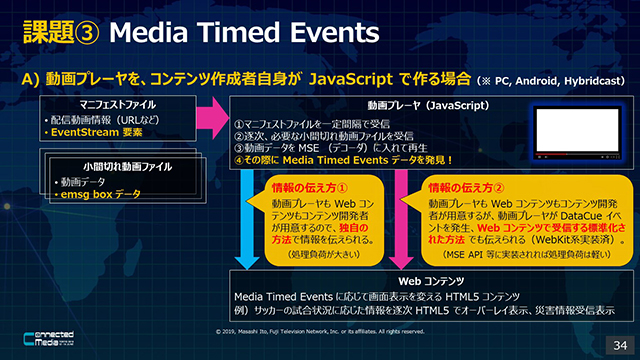

続いて伊藤氏は、配信動画における時間指定型のイベント「Media Timed Events」について説明。災害速報など安心・安全をつかさどる情報の即時伝達やデータ放送におけるイベントメッセージのように、時刻に紐付いたコンテンツ動作を可能にする伝送技術・受信技術を紹介した。

伝送技術の面では、「HLS」における情報挿入や字幕で用いられている外部ファイルを用いて再生時刻との紐づけを行う方法などが提示されたが、伊藤氏は「汎用手段として期待されるもの」として、「MPEG-DASH」や「CMAF」を用いた情報挿入を提唱した。具体的には、動画の並び順を定義するMPEG-DASHのマニフェストファイル内に時刻情報をふくむトリガー情報を埋め込む方法や、CMAF動画ファイル内の「emsg box」というメッセージデータ領域に同様の情報を埋め込む方法によって、時刻をトリガーとした情報表示を可能とする。

受信技術の面では、時刻に紐づくこれらの情報を、端末側でインタラクティブな動作を定義可能な仕組みである「JavaScript」プログラムに伝える方法を紹介。トリガーとなる情報を動画プレーヤーが受け取り、端末サイドのプログラムに伝える方法を示した。

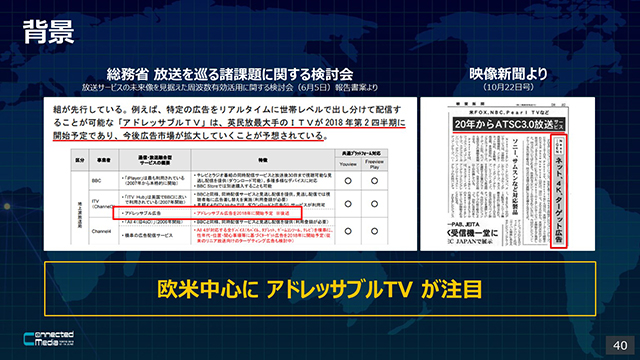

■端末ごとに広告を差し替える「Addressable TV」への対応

端末ごとに広告を差し替える技術「Addressable TV」。海外では欧米を中心に実用化が進んでいるが、フジテレビでも、放送と通信の新たな連携の形である「ハイブリッドキャスト」を使った技術面での実証実験を行って来たという。

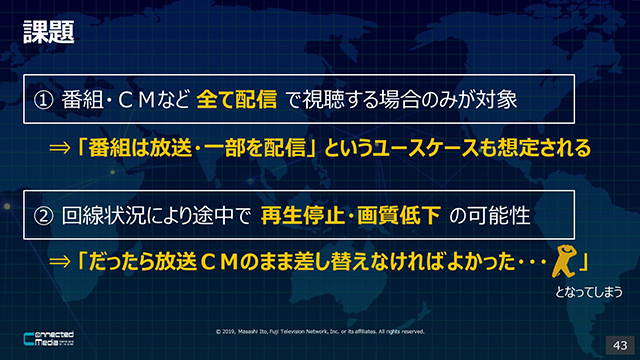

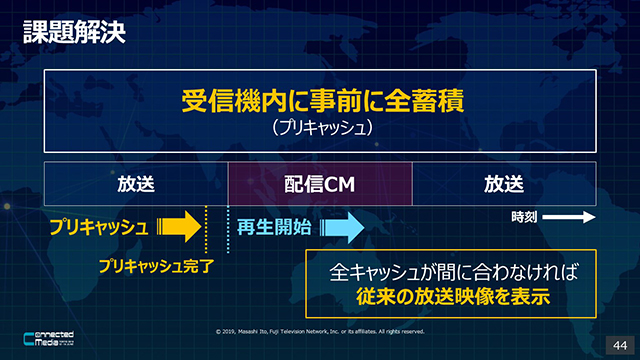

現在の地上デジタル放送の運用では配信形式の動画ファイルを送れないため、「Addressable TV」用の広告動画はインターネットを用いて端末に届ける。原則的に品質が一定である放送波に対し、配信の場合は回線状況によって動画の品質が大きく左右され、差し替え広告の再生途中での停止や画質劣化が生じる可能性も考慮しなければいけない。また、これまでの取り組みでは、「本編・CMをふくむすべてのプログラムを配信で視聴する」ことを前提としてきたが、「番組の一部は放送で視聴し、一部を配信で視聴する」といった組み合わせも想定される。

この課題を解決するため、伊藤氏は「事前に広告動画データを端末側にダウンロードさせておき、トリガーを受けて映像を切り替える」という方法を提唱。配信動画を受信するための受信端末内のプログラム命令を“上書き”して、事前に蓄積しておいた動画データをあたかも新たに受信したかのように処理することで、端末側の動画プレーヤーを変えることなく広告動画データの事前読み込みを実現、再生の安定化につなげるという。

さらに「再生対象のデータをすべて受信できた場合にのみ、配信映像に切り替えるようにすることで、より確実な再生を実現できる」と伊藤氏は述べた。

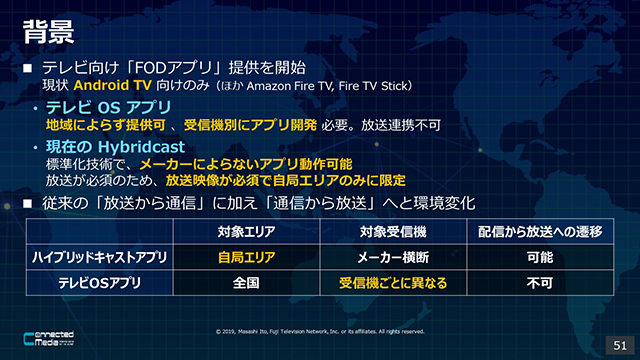

■「放送の受信状態に依存しないアプリケーション」

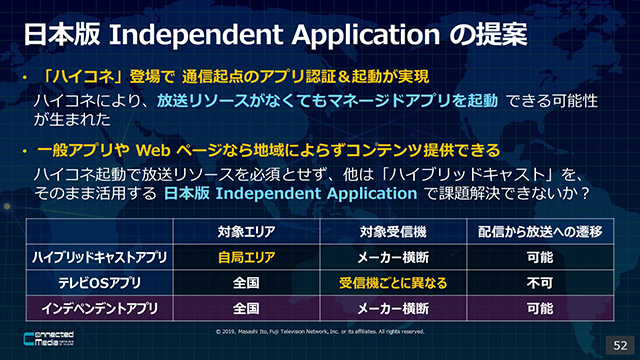

つづいて伊藤氏は、放送と通信の新たな連携の形である「ハイブリッドキャスト」における新たなアプリケーションの取り組みに言及。これまでの放送波を軸とした連携から、セカンドスクリーン向けアプリケーションを起点として、放送波の受信状態によらずに放送局のハイブリッドキャストアプリケーションを起動できる「日本版Broadcast Independent Application」の概念を提唱、提案した。

これまでのハイブリッドキャストでは、放送波をテレビで受信し、放送信号の情報を基にアプリケーションを起動させる方法を主軸としてきた。この場合、ハイブリッドキャストは標準規格なのでテレビメーカーによらず共通のアプリケーションを動かせる。しかし、最初に放送波を用いるため、サービス展開できるエリアが自局の放送エリアに限定される。一方、テレビで動作するアプリケーションにはAndroidTVのようなテレビOSのプラットフォームで動作するものもある。この場合は全国にサービス展開できるものの、放送局のアプリケーションであっても放送と連携できず、さらにテレビごとにプラットフォームが異なるため、環境に応じてアプリケーションを作り分けなければならない。

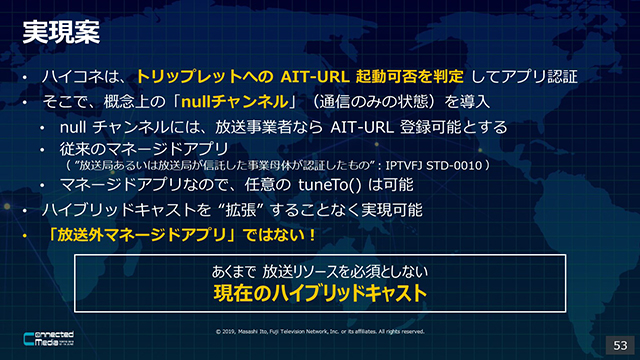

伊藤氏は、スマートフォンアプリケーションを起点としてテレビの動作を制御するハイブリッドキャストソリューション「ハイコネ」に着目。通常「ハイコネ」は、特定の放送局ごとにアプリケーションと放送チャンネルを紐付けるが、Broadcast Independent Applicationでは放送局共通の「概念上の架空チャンネル」を定義し紐付ける。これにより、既存のハイブリッドキャストの仕組みを替えず、放送局アプリケーションならではの放送への遷移も可能で、かつ動画配信などの通信コンテンツを全国展開することが可能になるという。

「『放送外マネージドアプリ』という技術があるが、それとはまったく異なり、あくまで現在のハイブリッドキャスト上の仕組み。通信を起点にハイブリッドキャストを起動する「ハイコネ」によって放送と連携前の状態も扱えるようになり、ローカル局のアプリケーションも全国に提供可能となる。しかもハイブリッドキャストは放送局や放送局が信託した団体のアプリケーションであるため、動画配信などのサービスから新たな放送への遷移も期待できる」と伊藤氏は語った。

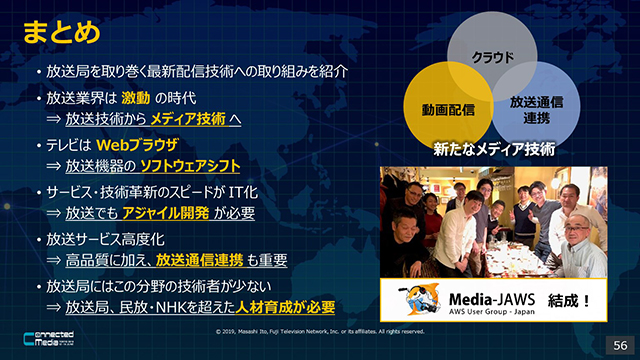

■まとめ

「我々は『放送技術』から『メディア技術』へと視野を広げる必要がある」と伊藤氏。「現在のテレビは実は『WEBブラウザ』であり、放送機器もハードからソフトウェアが主体のものへと変化しつつある」と述べ、放送業界におけるサービス・技術革新のスピードがIT業界の水準になっていることを示唆した。

キャプション文字

キャプション文字この潮流に対応するため、「放送業界においても『アジャイル開発(Agile:個々に独立して稼働し、システム同士の接続によって大規模・柔軟な機能を実現する開発手法)』の導入が必要」と伊藤氏。高品質化と放送通信連携の両輪が放送サービスの高度化につながると述べ、40分にわたるセッションを締めくくった。