AIナレーションの進化が、 映像制作の未来を変える

HEART CATCH 西村真里子

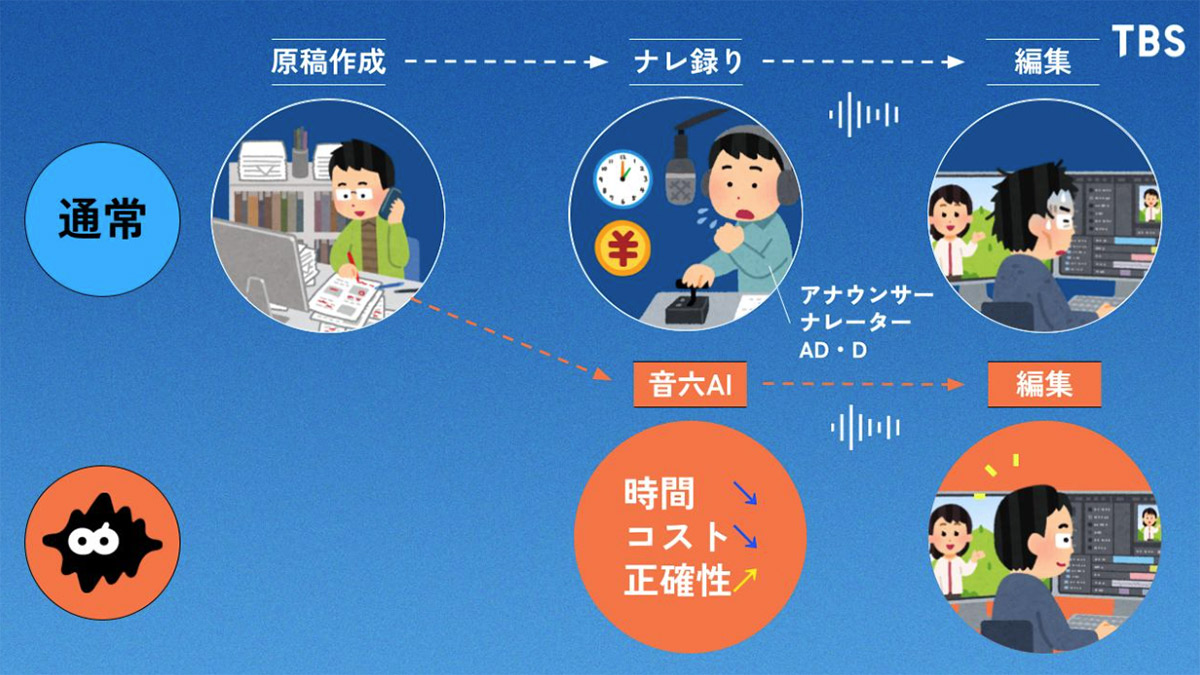

映像制作の現場では、ナレーションの収録が欠かせない工程の一つだ。しかし、そのプロセスには時間とコストがかかり、制作スケジュールを圧迫する要因にもなっていた。そんな課題を解決するために、TBS技術部が開発したのが AIナレーション生成システム「音六AI」 である。

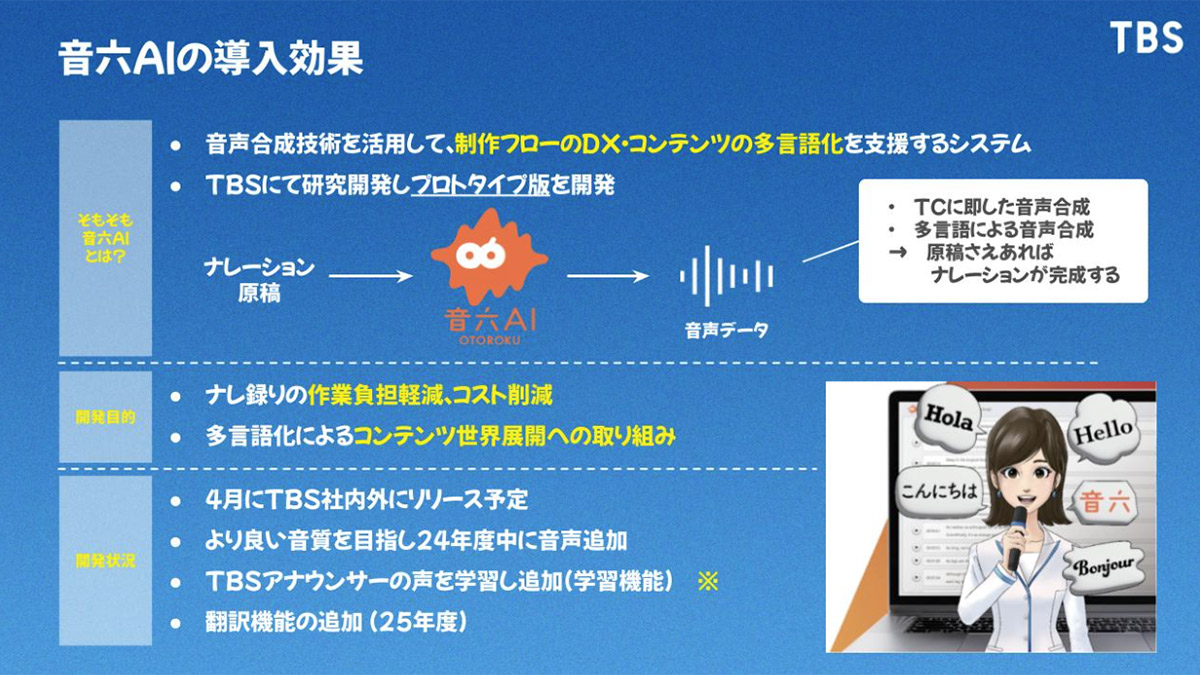

当初は放送局内部の業務効率化を目的として開発されたが、その利便性の高さから、今や社内外での活用が進んでいる。「音六AI」の導入により、制作現場では仮ナレーションを即座に生成できるようになり、編集作業のスピードが飛躍的に向上。さらには、AIによるタイムコード対応の音声生成や、多言語展開の可能性も広がっている。

さて、この「音六AI」が、新たな市場を切り拓いていくために考えていくべきことは何か?本記事では、「音六AI」の開発背景や技術的特徴を紹介した後に、「音六AI」ビジネス展開をクリエイティブに考えるメンバーで行ったトークセッション TBS アフター6テックナイト の内容をお届けする。「音六AI」の紹介はTBS大西陽一氏が行い、トークセッションではサンフランシスコ在住のデザインファーム btrax 代表 ブランドン・ヒル氏、VR関連デバイスを開発するハードウェアスタートアップ Shiftall 代表 岩佐琢磨氏、AR三兄弟 長男 川田十夢氏、TBSイノベーションドライブ 代表パートナー 西川直樹氏、HEART CATCH 代表 西村真里子 が「音六AI」開発担当 TBS 大西陽一氏 とディスカッションを行った。大いに盛り上がったセッションの核となる「音六AI」についてまず紹介する。

■AIナレーション「音六AI」とは?

TBS技術部が開発した「音六AI」は、AIを活用したナレーション生成システムである。当初は放送局内部の業務効率化を目的に開発されたが、現在は社内外での利用が進んでいる。特に、制作現場での仮ナレーション作成の手間を省き、迅速に音声を生成することができる点が特徴だ。従来、テレビ番組制作の現場では、放送前の段階で仮ナレーションを入れる必要があり、ADやディレクターが自らナレーションを録音することが一般的だった。この作業は手間がかかり、またプロデューサーの指示のもと何度も修正を重ねる必要があった。

「音六AI」はこの課題を解決するために開発されたシステムであり、原稿がある場合、それをAIに読み込ませることで簡単に仮ナレーションを生成できる。特にタイムコードに即した音声の作成が可能であり、制作フローの簡素化や業務負担の軽減に大きく貢献している。また、TBSがグローバル展開を進める中で、多言語対応も視野に入れて開発が進められている。

「音六AI」の最大の特徴は、タイムコード対応のナレーション生成が可能である点にある。原稿にタイムコードを付与することで、編集作業をスムーズに進めることができる。また、コスト削減にも大きく寄与しており、従来ナレーターに発注していた費用が、AIナレーションの導入により大幅に削減される。これにより、制作現場の業務負担が軽減されるだけでなく、多言語対応も可能になり、幅広いコンテンツでの活用が期待されている。加えて、操作性の簡便さも大きな魅力の一つだ。原稿をコピー&ペーストするだけで音声が生成できる仕組みとなっており、特別な技術がなくても簡単に利用することができる。さらに、速度調整機能が搭載されており、指定された尺に収まるように自動で調整されるため、より柔軟なナレーション生成が可能となっている。

「音六AI」はすでにTBSのさまざまなコンテンツで活用されている。具体的には、『クレイジージャーニー』や『TBSレビュー』などのテレビ番組で使用されており、YouTubeのTBS芸能情報チャンネルなどでもAIナレーションが活躍している。また、番組のプロモーション部門でも活用されており、ナレーションを必要とするプロモーション動画の制作がスムーズに進められている。教育分野でも「音六AI」の導入が進んでおり、「やる気スイッチグループ」の教材コンテンツでは、英語教材のナレーションにAIが活用されている。これにより、ネイティブスピーカーを手配する手間を省きつつ、高品質な音声教材を提供することが可能となっている。

TBSでは、「音六AI」を活用し、従来の制作フローをさらに効率化するとともに、ナレーションを必要とするコンテンツの拡充を進めていく方針である。これにより、地上波のみならずYouTubeやNetflixといったプラットフォームへのコンテンツ展開が容易になり、放送局としての競争力強化にもつながると期待されている。

全国28局の試験運用も実施されており、2024年度は無料トライアルを行い、2025年4月から正式導入が予定されている。今後、正式リリースを控えている「音六AI」は、放送業界のみならず、さまざまな分野での活用が期待される革新的なAIナレーションシステムである。さて、この「音六AI」のビジネスを国内外でスケールさせるためにはどのような進化を遂げる必要があるのか?「アフター6テックナイト」イベントのトークセッションの中身をお届けする。

■トークセッション:AI音声技術の可能性と課題

btraxブランドン・ヒル(以下、ブランドン):うちの会社では、中国のスタートアップの日本展開をサポートしています。彼らの動画生成AIにはナレーション機能があり、文字を入力すると自動で音声を生成するのですが、漢字の読み方が音読み・訓読みで間違うことがあるんです。この点について大西さんが説明された「音六AI」がどのように対応されているのか興味があります。

TBS大西:おっしゃる通り、日本語の音声合成は非常に難しい課題です。特に二字熟語や四字熟語では、前後の単語によって発音が変わることがあり、その処理が重要になります。私たちのシステムでは、特定の単語を選択し、発音を指定できるようにしています。例えば『高校野球』のような単語では、単独の『野球』の発音を調整するだけで、全体のイントネーションが適切に修正される仕組みです。また、一文字単位でイントネーションを細かく修正する機能も提供しています。

HEART CATCH西村(以下、西村):地域によってイントネーションが異なりますが、関西弁のようなローカルデータベースを構築することは可能ですか?

TBS大西:それは良いアイデアです。ローカライズは非常に重要で、地方局などにも利用してもらいたいと考えています。方言や訛りを学習し、データベースとして提供できれば、より自然な発音を実現できます。

Shiftall岩佐琢磨(以下、岩佐):イントネーションのビッグデータを活用することが鍵ですね。4月リリースのバージョンでは学習データはまだ取り込まれていないのですか?

TBS大西:4月の段階では学習データなしでスタートします。ただ、将来的にはNHKのアクセント辞典のような標準的なデータを取り込むことで、初期状態でも高精度な発音が可能になるようにしたいと考えています。

岩佐:テクノロジーとして新しいわけではないので、結局はデータベースの蓄積がビジネスの強みになりますよね。

西村:海外の企業が日本市場に参入する際、日本語のナレーションが不自然な動画をよく見かけます。こうした企業向けに提供すると、日本市場での訴求力が高まりそうですね。

ブランドン:ただ、悪用リスクも考えなければなりません。国際ロマンス詐欺などで、AI生成のかわいい声が使われる可能性もありますし。

TBS大西:音声技術は参入しやすい分、ルールや権利関係のハードルが高い分野です。技術が進んでも、意外な壁が出てくる可能性があります。弊社でも、テクノロジーの発展とともに悪用リスクが高まることを意識しており、発信者として責任を持つ必要があると考えています。」

ブランドン:ハリウッドでも同様の問題が議論されています。俳優を数分間スキャンするだけで、2時間の映画が制作可能になり、従来のギャラが大幅に削減される事例もあります。

岩佐:テクノロジーの発展で富の再分配が起こるのは当然の流れです。過去にも同様の変化がありましたし、ナレーターや俳優の仕事も同じように進化していくのではないでしょうか。

AR三兄弟 川田十夢(以下、川田):「お風呂が沸きました」の声の人はいまだにいる。それと一緒でニーズがあるところには人間の声が使われるのではないでしょうか?

さて、ブルース・ウィリスさんが最近AI化されました。今後TikTokとかにブルース・ウィリスが使えるようになるかもしれない。それはそれで面白いですよね。ブルース・ウィリスはやっぱね、好きなんですよ。好きだから、例えばこの部屋の配管とか、ダクトがあるとブルース・ウィリスをARで出現させたい。このような「カジュアル化」という流れもあるんですよ。カジュアル化はたくさん人が安価に使う。今までの巨額なハリウッド予算とは別のお金の流れが生まれるんだと思うんです。

岩佐:UGC(ユーザー生成コンテンツ)の活用も有効ですね。例えば、声のデータをアップロードした人に報酬を還元する仕組みがあれば、グローバルな規模で発展する可能性があります。

ブランドン:時代に合っていますね。アメリカのローカルニュースでは、映像のナレーション部分はすでにAIが担っています。人が話すシーン以外はすべてAI音声になっているんですよ。

TBS大西:NHKでも一部の映像にはAI音声を使用していると聞きます。実際、私たちも最初は外部の技術を使う予定でしたが、長期的なメリットを考えて自社開発に踏み切りました。

ブランドン:音声技術の競争は、データの量とローカルな調整の精度が鍵になります。特に方言やイントネーションのチューニングは、日本語特有の課題ですが、ここにしっかり取り組めば他社との差別化ができるはずです。

TBS大西:例えば「声フォント」さんは、音声を学習した本人に対して売上に応じたフィードバックを行うエコシステムを構築しています。これを参考にテレビ局の今後の仕組みを検討すべきですし、今後、必ず考えなければならないテーマだと感じます。

岩佐:僕はUGCが大好きで、VR業界でもUGCクリエイターによって回っています。最近では、RVC(AI技術を活用した声変換ツール)の音声モデルをpixiv社が提供するbooth(データなどのオンライン販売ができるサービス)で販売する例も増えてきました。ただ、現状は売り切り型のため、もし公募制にして、自分で応募できるような仕組みがあれば面白いと思います。

例えば、応募する際に「こういう使い方は禁止」といった使われ方を声の持ち主が設けられるようなルールを作った上で、誰でも投稿できるようにし、その上でレベニューシェアの仕組みを導入する。これにより、グローバル展開も容易になるでしょう。特に、GDPが低い国でも英語や中国語が堪能な人々が多く、そうした方々にも貢献できる仕組みが作れるのではないかと思います。

西村:素朴な疑問なのですが、「音六AI」がコスト削減につながるという話がありましたが、TBSグループ内での利用は理解できますが、外部への販売を考えたときに「音六AI」の利用料が、今までのナレーターコストよりも安価で魅力的な価格設定にする必要があります。この価格設定はじめビジネスモデルはどのように考えているのでしょうか?

TBS西川:同業界内では一定の理解があると思いますが、特に他者のIPを使用するリスクがあるため、有名人の声を模倣するのは難しいでしょう。そのため、まずは制作過程での利用を推進し、放送局やYouTubeの制作現場で使ってもらうのが入口として適していると思います。

次の展開としては、TBSアナウンサーの声が公式に使用できるようにすることで、誰に刺さるのかを明確に設計する必要があります。技術的な優位性が確保しづらくなった際、TBSのIPを活かしたビジネスモデルを構築できると良いですね。

ブランドン:アメリカのローカルニュースでは、映像は人が出演する一方で、ナレーションはAIが担当するケースが増えています。日本でも同様の流れが進むでしょう。

先ほども申ましたが、データ量の確保とローカル性のファインチューニングの2つが重要です。特に、方言やイントネーションの細かいチューニングはスタートアップには難しいため、ここに優位性を築ける可能性があります。

岩佐:TBSさんはIPやアナウンサーの権利など、慎重にならざるを得ない部分が多いと思います。ただ、この領域は非常に進化が速く、ちょっとしたオープンソースプロジェクトでも一気に発展する可能性があります。

例えば、クローズドな戦略に固執しすぎると、オープン戦略を採る企業に一気に抜かれてしまうリスクがあります。YouTubeとGyaOの関係のように、GyaOは早くから動画配信を行っていましたが、YouTubeがオープン戦略で一気にシェアを奪いました。この点を考えると、慎重さも必要ですが、早期にアクセルを踏むことも重要です。

ブランドン:YouTubeが成功した理由の一つは、有害コンテンツの排除が上手かったことです。アダルトコンテンツに流れがちだった他のサービスと違い、YouTubeは最初から有害コンテンツを排除する方針を取りました。これにより、安全な動画シェアサービスとして成長しました。

西村:データを蓄積しつつ、オープンなルール作りも重要ですね。

大西:何か一つでも強烈な強みがあると、競争が激化したときに「うちはこれをやるんだ」と言えるのが重要だと思います。例えば、日本全国の方言を網羅する仕組みを作るのも一つの強みになり得ます。

岩佐:強みをクローズドにしてしまうのは危険です。オープン戦略を取ることで、先行者優位が生まれ、データが集まりやすくなり、ファンが増えるという仕組みを作るべきです。

ブランドン:まさにWikipedia方式ですね。

岩佐:例えば、レベニューシェアの仕組みを導入し、音声モデルを提供した人に収益を還元する形にすれば、よりオープンなエコシステムが作れるでしょう。

川田:若い人のTikTok現象と、テレビの文体を繋げたら面白いと思っています。例えば、TikTokでは、わざとAIナレーションのような話し方で「どこどこに行ってきた」といった説明口調の投稿が流行っています。

テレビの文体でこの流れを考えたとき、『世界ウルルン滞在記』のように、誰もが真似したくなるナレーションの文体がたくさんあります。これを上手く誰でも使えるようにし、みんなが使えるようにすると、激バズりする可能性があります。これがあれば、まだTikTokに馴染んでない上の世代、テレビ世代もTikTokに親しみやすくなりますし、テレビのマジックをネット文化に翻訳しながら繋げることで、新しいサービスとして展開できるはずです。

テレビには「テレビ・スラング」があります。このスラングをテレビ外でも活用できるように、ナレーターさんなどと初期の契約から合意をとっておくのが大事なのではないでしょうか?

ブランドン:ただ、テレビのクオリティが高すぎるため、ネット向けにデチューン(品質を落とす)する必要があるかもしれませんね。gifアニメもミームなど、完璧ではなく、荒さのあるコンテンツのほうがネットでは受けやすいので、その匙加減が難しそうですね。

・「音六AI」のお問い合わせ、TBS技術サービスのポータルサイト「TBS Tech Portal」 https://www.tbs.co.jp/techportal/

・TBSイノベーションスペース「Tech Design X」 https://techdesignlab.net/X/